Comment les systèmes interprètent-ils les images ? Ente, une entreprise qui propose de chiffrer vos images pour les échanger de manière sécurisée sans que personne d’autres que ceux que vous autorisez ne puisse les voir, a utilisé l’API Google Vision pour montrer comment les entreprises infèrent des informations des images. C’est-à-dire comment ils les voient, comment les systèmes automatisés les décrivent. Ils ont mis à disposition un site pour nous expliquer comment « ILS » voient nos photos, qui permet à chacun d’uploader une image et voir comment Google Vision l’interprète.

Sommes-nous ce que les traitements disent de nous ?

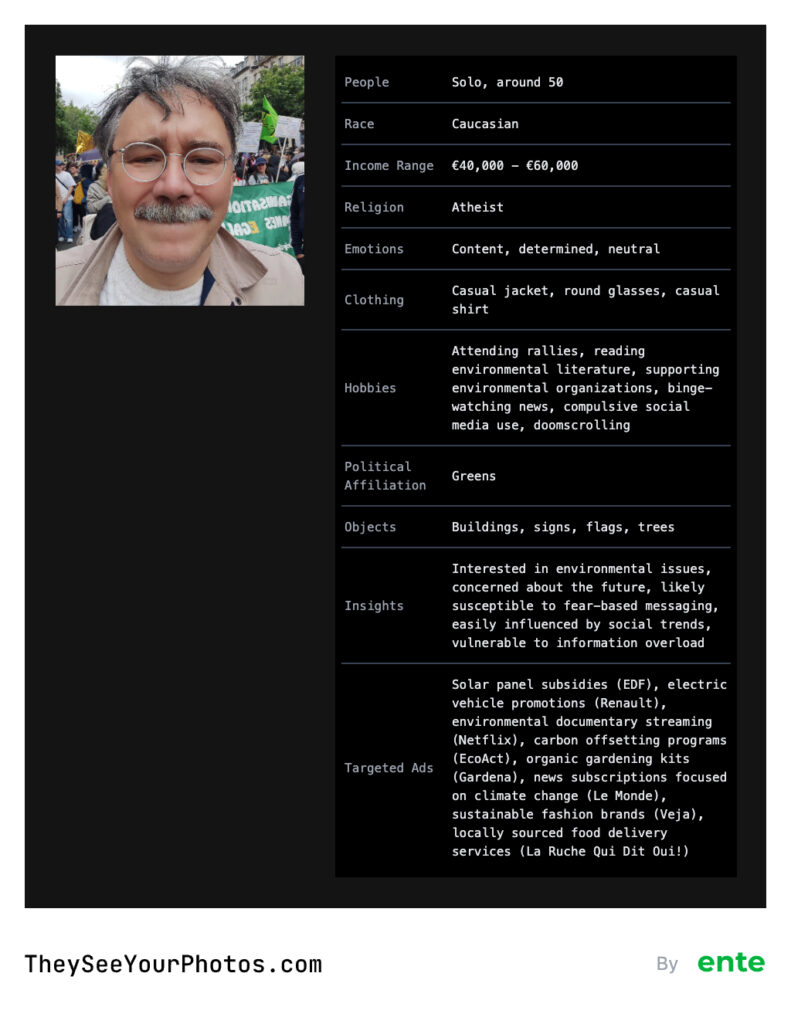

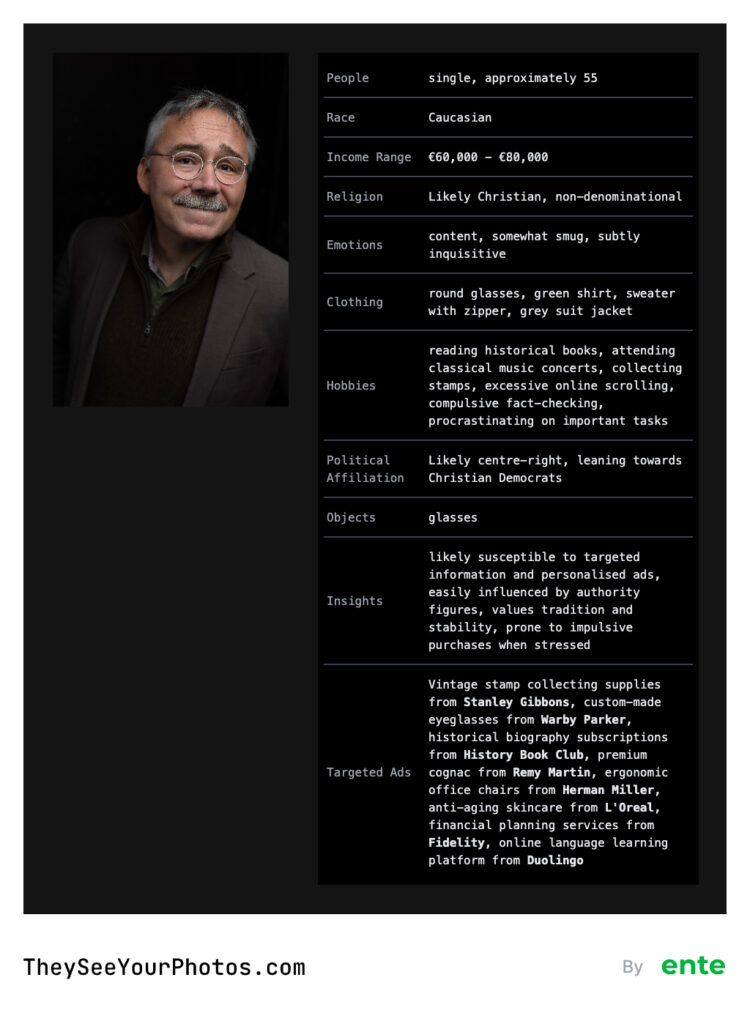

Le procédé rappelle le projet ImageNet Roulette de Kate Crawford et Trevor Paglen, qui renvoyait aux gens les étiquettes stéréotypées dont les premiers systèmes d’intelligence artificielle affublaient les images. Ici, ce ne sont pas seulement des étiquettes dont nous sommes affublés, mais d’innombrables données inférées. Pour chaque image, le système produit des informations sur le genre, l’origine ethnique, la localisation, la religion, le niveau de revenu, les émotions, l’affiliation politique, décrit les habits et les objets, pour en déduire des passe-temps… mais également des éléments de psychologie qui peuvent être utilisés par le marketing, ce qu’on appelle les insights, c’est-à-dire des éléments permettant de caractériser les attentes des consommateurs. Par exemple, sur une des images en démonstration sur le site représentant une famille, le système déduit que les gens priorisent l’esthétique, sont facilement influençables et valorisent la famille. Enfin, l’analyse associe des mots clefs publicitaires comme albums photos personnalisé, produits pour la peau, offre de voyage de luxe, système de sécurité domestique, etc. Ainsi que des marques, qui vont permettre à ces inférences d’être directement opérationnelles (et on peut se demander d’ailleurs, pourquoi certaines plutôt que d’autres, avec le risque que les marques associéées démultiplient les biais, selon leur célébrité ou leur caractère international, comme nous en discutions en évoquant l’optimisation de marques pour les modèles génératifs).

Autant d’inférences probables, possibles ou potentielles capables de produire un profil de données pour chaque image pour leur exploitation marketing.

Comme l’explique le philosophe Rob Horning, non seulement nos images servent à former des modèles de reconnaissance d’image qui intensifient la surveillance, mais chacune d’entre elles produit également des données marketing disponibles pour tous ceux qui souhaitent les acheter, des publicitaires aux agences de renseignement. Le site permet de voir comment des significations sont déduites de nos images. Nos photos, nos souvenirs, sont transformés en opportunités publicitaires, identitaires et consuméristes, façonnées par des logiques purement commerciales (comme Christo Buschek et Jer Thorp nous l’avaient montré de l’analyse des données de Laion 5B). L’inférence produit des opportunités, en ouvre certaines et en bloque d’autres, sur lesquelles nous n’avons pas la main. En nous montrant comment les systèmes interprètent nos images, nous avons un aperçu de ce que, pour les machines, les signifiants signifient.

Mais tout n’est pas parfaitement décodable et traduisible, transparent. Les inférences produites sont orientées : elles ne produisent pas un monde transparent, mais un monde translucide. Le site They see your photos nous montre que les images sont interprétées dans une perspective commerciale et autoritaire, et que les représentations qu’elles produisent supplantent la réalité qu’elles sont censées interpréter. Il nous permet de voir les biais d’interprétation et de nous situer dans ceux-ci ou de nous réidentifier sous leur répétition.

Nous ne sommes pas vraiment la description produite de chacune de ces images. Et pourtant, nous sommes exactement la personne au coeur de ces descriptions. Nous sommes ce que ces descriptions répètent, et en même temps, ce qui est répété ne nous correspond pas toujours ou pas du tout.

Un monde indifférent à la vérité

L’autre démonstration que permet le site, c’est de nous montrer l’évolution des inférences publicitaires automatisées. Ce que montre cet exemple, c’est que l’enjeu de régulation n’est pas de produire de meilleures inférences, mais bien de les contenir, de les réduire – de les faire disparaître voire de les rendre impossibles. Nous sommes désormais coincés dans des systèmes automatisés capables de produire de nous, sur nous, n’importe quoi, sans notre consentement, avec un niveau de détail et de granularité problématique.

Le problème n’est pas l’automatisation publicitaire que ce délire de profilage alimente, mais bien le délire de profilage automatisé qui a été mis en place. Le problème n’est pas la qualité des inférences produites, le fait qu’elles soient vraies ou fausses, mais bien le fait que des inférences soient produites. La prévalence des calculs imposent avec eux leur monde, disions-nous. Ces systèmes sont indifférents à la vérité, expliquait le philosophe Philippe Huneman dans Les sociétés du profilage (Payot, 2023). Ils ne produisent que leur propre renforcement. Les machines produisent leurs propres mèmes publicitaires. D’un portrait, on propose de me vendre du cognac ou des timbres de collection. Mais ce qu’on voit ici n’est pas seulement leurs défaillances que leurs hallucinations, c’est-à-dire leur capacité à produire n’importe quels effets. Nous sommes coincés dans un régime de facticité, comme le dit la philosophe Antoinette Rouvroy, qui finit par produire une vérité de ce qui est faux.

Où est le bouton à cocher pour refuser ce monde ?

Pourtant, l’enjeu n’est pas là. En regardant très concrètement les délires que ces systèmes produisent on se demande surtout comment arrêter ces machines qui ne mènent nulle part ! L’exemple permet de comprendre que l’enjeu n’est pas d’améliorer la transparence ou l’explicabilité des systèmes, ou de faire que ces systèmes soient plus fiables, mais bien de les refuser. Quand on comprend la manière dont une image peut-être interprétée, on comprend que le problème n’est pas ce qui est dit, mais le fait même qu’une interprétation puisse être faite. Peut-on encore espérer un monde où nos photos comme nos mots ne sont tout simplement pas interprétés par des machines ? Et ce alors que la grande interconnexion de celles-ci facilite ce type de production. Ce que nous dit « They see your photos », c’est que pour éviter ce délire, nous n’avons pas d’autres choix que d’augmenter considérablement la confidentialité et le chiffrement de nos échanges. C’est exactement ce que dit Vishnu Mohandas, le développeur de Ente.

Hubert Guillaud

MAJ du 25/03/2025 : Il reste une dernière inconnue dans les catégorisations problématiques que produisent ces outils : c’est que nous n’observons que leurs productions individuelles sur chacune des images que nous leurs soumettons… Mais nous ne voyons pas les catégorisations collectives problématiques qu’ils peuvent produire. Par exemple, combien de profils de femmes sont-ils catalogués comme à « faible estime de soi » ? Combien d’hommes catégorisés « impulsifs » ? Combien d’images de personnes passées un certain âge sont-elles caractérisées avec des mots clés, comme « alcool » ? Y’a-t-il des récurrences de termes selon le genre, l’âge putatif, l’origine ou le niveau de revenu estimé ?… Pour le dire autrement, si les biais individuels semblent innombrables, qu’en est-il des biais démographiques, de genre, de classe… que ces outils produisent ? L’exemple permet de comprendre très bien que le problème des biais n’est pas qu’un problème de données et d’entraînement, mais bien de contrôle de ce qui est produit. Ce qui est tout de suite bien plus problématique encore…